Hadoop分布式计算框架——MapReduce

本文于2413天之前发表,文中内容可能已经过时。

一、MapReduce概述

Hadoop MapReduce是一个分布式计算框架,用于编写批处理应用程序。编写好的程序可以提交到Hadoop集群上用于并行处理大规模的数据集。

MapReduce作业通过将输入的数据集拆分为独立的块,这些块由map以并行的方式处理,框架对map的输出进行排序,然后输入到reduce中。MapReduce框架专门用于<key,value>键值对处理,它将作业的输入视为一组<key,value>对,并生成一组<key,value>对作为输出。输出和输出的key和value都必须实现Writable 接口。

1 | (input) <k1, v1> -> map -> <k2, v2> -> combine -> <k2, v2> -> reduce -> <k3, v3> (output) |

二、MapReduce编程模型简述

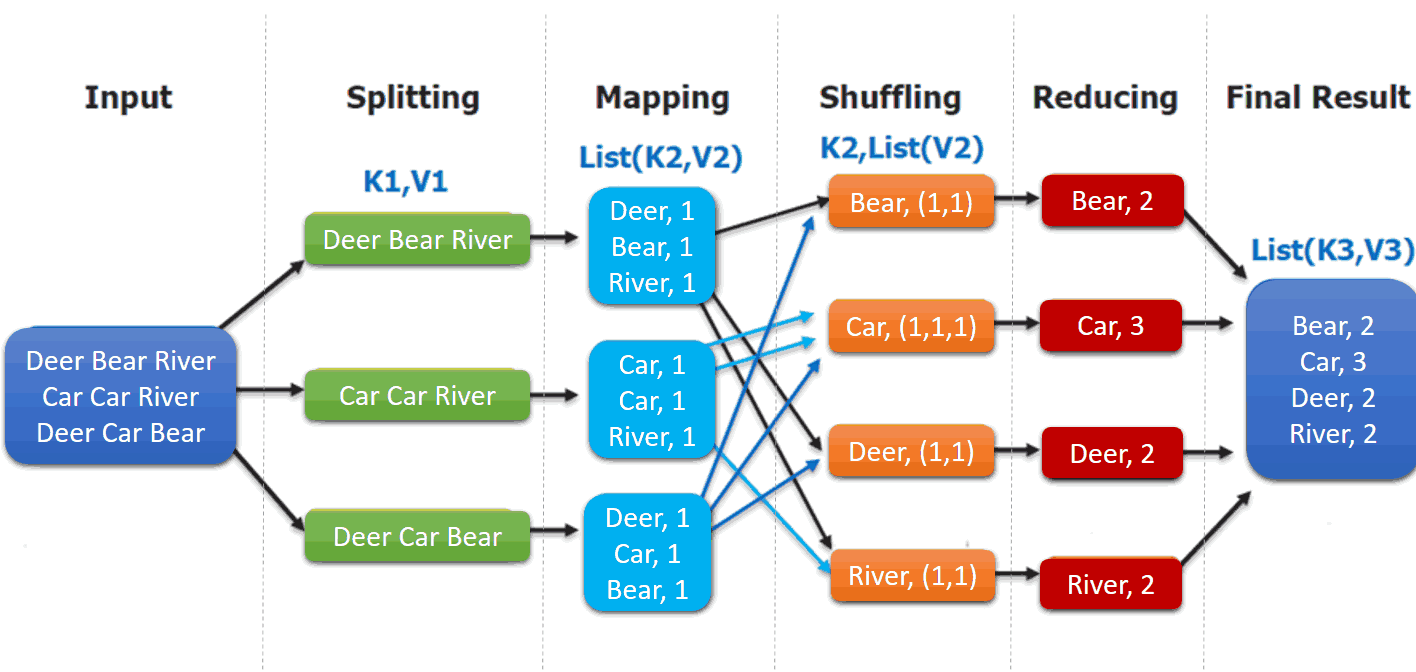

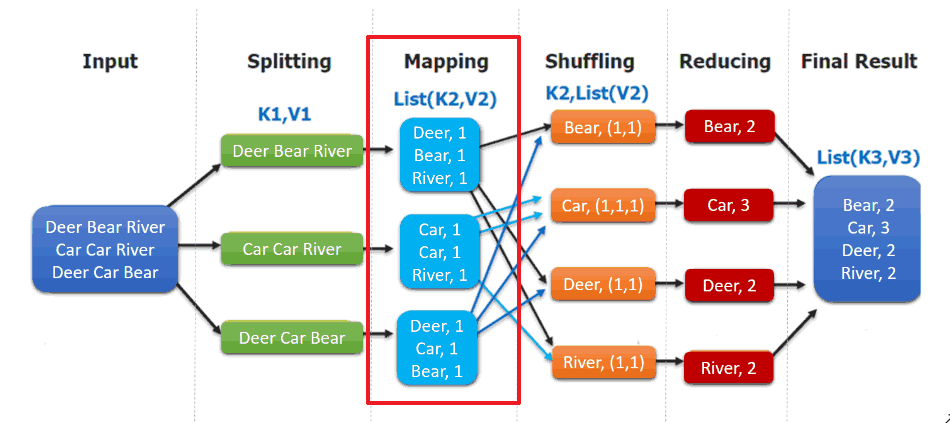

这里以词频统计为例进行说明,MapReduce处理的流程如下:

input : 读取文本文件;

splitting : 将文件按照行进行拆分,此时得到的

K1行数,V1表示对应行的文本内容;mapping : 并行将每一行按照空格进行拆分,拆分得到的

List(K2,V2),其中K2代表每一个单词,由于是做词频统计,所以V2的值为1,代表出现1次;shuffling:由于

Mapping操作可能是在不同的机器上并行处理的,所以需要通过shuffling将相同key值的数据分发到同一个节点上去合并,这样才能统计出最终的结果,此时得到K2为每一个单词,List(V2)为可迭代集合,V2就是Mapping中的V2;Reducing : 这里的案例是统计单词出现的总次数,所以

Reducing对List(V2)进行归约求和操作,最终输出。

MapReduce编程模型中splitting 和shuffing操作都是由框架实现的,需要我们自己编程实现的只有mapping和reducing,这也就是MapReduce这个称呼的来源。

三、combiner & partitioner

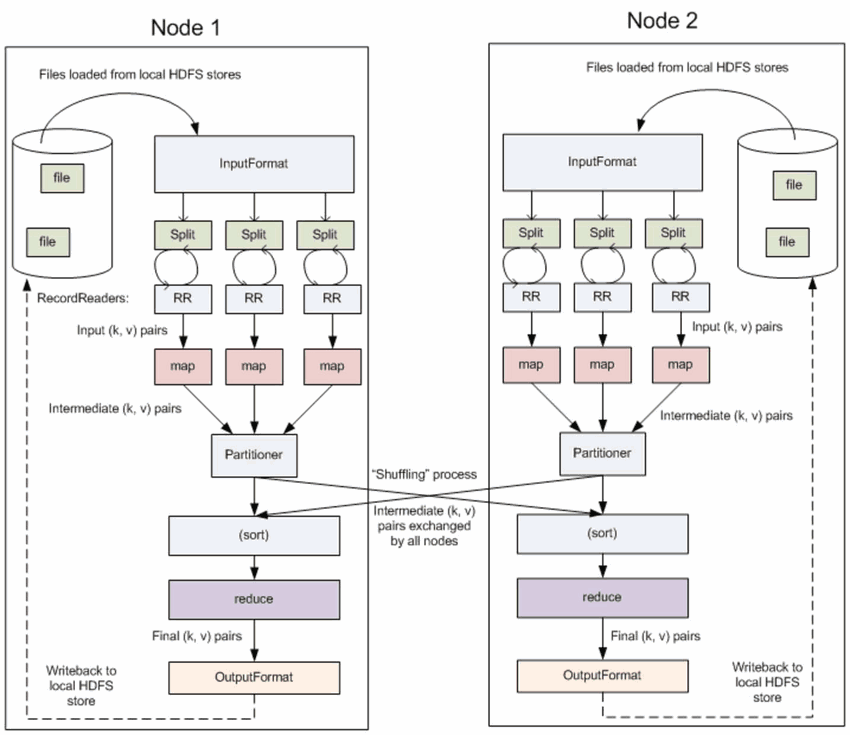

3.1 InputFormat & RecordReaders

InputFormat将输出文件拆分为多个InputSplit,并由RecordReaders将InputSplit转换为标准的<key,value>键值对,作为map的输出。这一步的意义在于只有先进行逻辑拆分并转为标准的键值对格式后,才能为多个map提供输入,以便进行并行处理。

3.2 Combiner

combiner是map运算后的可选操作,它实际上是一个本地化的reduce操作,它主要是在map计算出中间文件后做一个简单的合并重复key值的操作。这里以词频统计为例:

map在遇到一个hadoop的单词时就会记录为1,但是这篇文章里hadoop可能会出现n多次,那么map输出文件冗余就会很多,因此在reduce计算前对相同的key做一个合并操作,那么需要传输的数据量就会减少,传输效率就可以得到提升。

但并非所有场景都适合使用combiner,使用它的原则是combiner的输出不会影响到reduce计算的最终输入,例如:求总数,最大值,最小值时都可以使用combiner,但是做平均值计算则不能使用combiner。

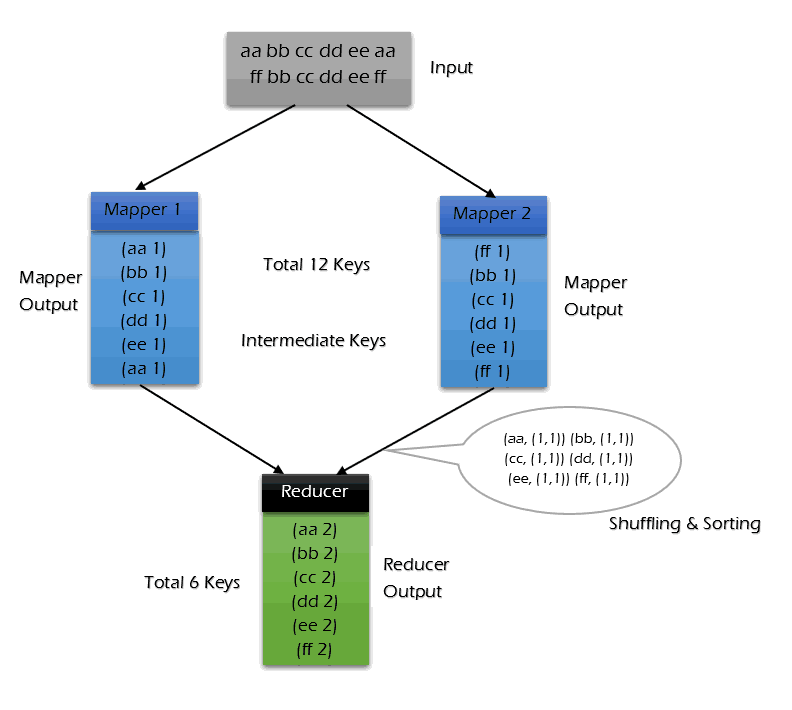

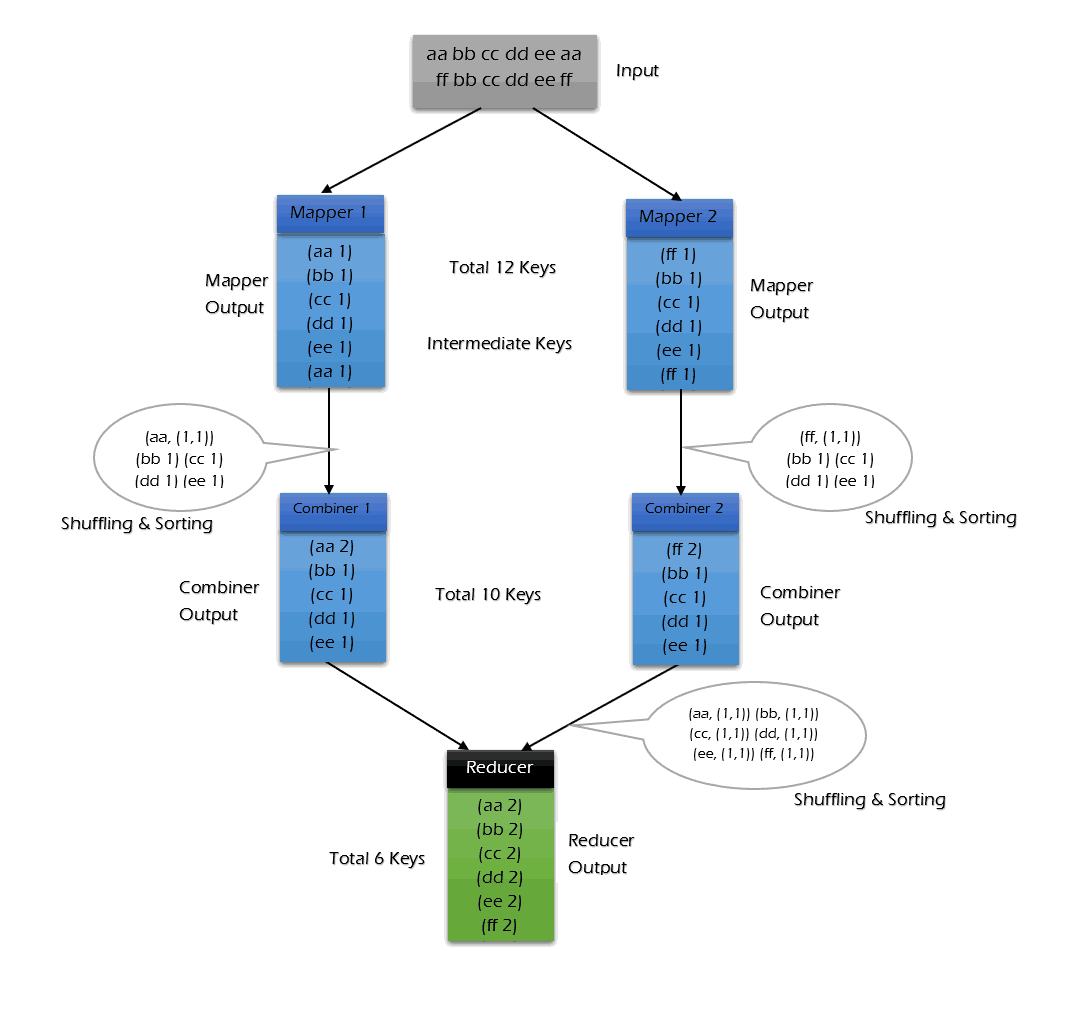

不使用combiner的情况:

使用combiner的情况:

可以看到使用combiner的时候,需要传输到reducer中的数据由12keys,降低到10keys。降低的幅度取决于你keys的重复率,下文词频统计案例会演示用combiner降低数百倍的传输量。

3.3 Partitioner

partitioner可以理解成分类器,将map的输出按照key值的不同分别分给对应的reducer,支持自定义实现,下文案例会给出演示。

四、MapReduce词频统计案例

4.1 项目简介

这里给出一个经典的词频统计的案例:统计如下样本数据中每个单词出现的次数。

1 | Spark HBase |

为方便大家开发,我在项目源码中放置了一个工具类WordCountDataUtils,用于模拟产生词频统计的样本,生成的文件支持输出到本地或者直接写到HDFS上。

项目完整源码下载地址:hadoop-word-count

4.2 项目依赖

想要进行MapReduce编程,需要导入hadoop-client依赖:

1 | <dependency> |

4.3 WordCountMapper

将每行数据按照指定分隔符进行拆分。这里需要注意在MapReduce中必须使用Hadoop定义的类型,因为Hadoop预定义的类型都是可序列化,可比较的,所有类型均实现了WritableComparable接口。

1 | public class WordCountMapper extends Mapper<LongWritable, Text, Text, IntWritable> { |

WordCountMapper对应下图的Mapping操作:

WordCountMapper继承自Mappe类,这是一个泛型类,定义如下:

1 | WordCountMapper extends Mapper<LongWritable, Text, Text, IntWritable> |

- KEYIN :

mapping输入key的类型,即每行的偏移量(每行第一个字符在整个文本中的位置),Long类型,对应Hadoop中的LongWritable类型; - VALUEIN :

mapping输入value的类型,即每行数据;String类型,对应Hadoop中Text类型; - KEYOUT :

mapping输出的key的类型,即每个单词;String类型,对应Hadoop中Text类型; - VALUEOUT:

mapping输出value的类型,即每个单词出现的次数;这里用int类型,对应IntWritable类型。

4.4 WordCountReducer

在Reduce中进行单词出现次数的统计:

1 | public class WordCountReducer extends Reducer<Text, IntWritable, Text, IntWritable> { |

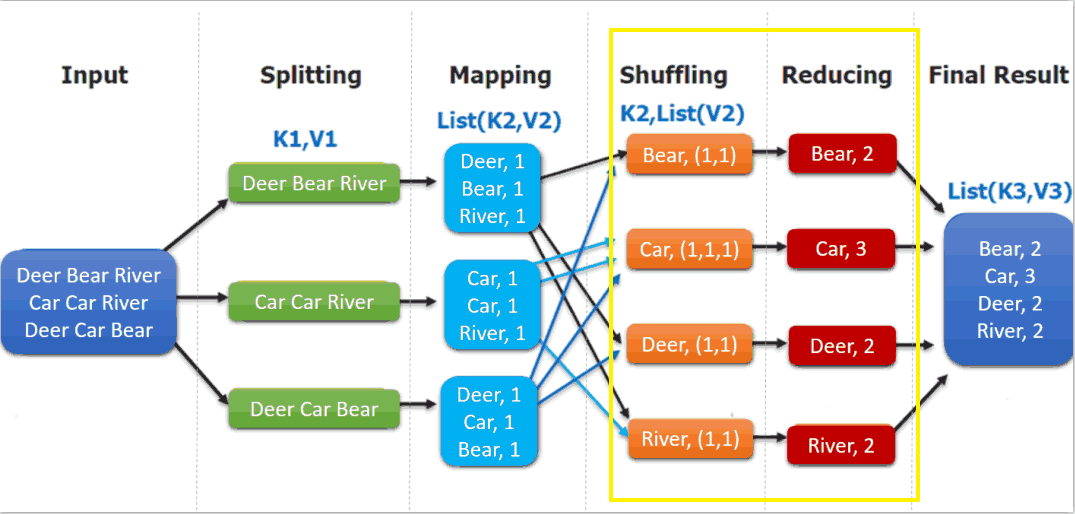

如下图,shuffling的输出是reduce的输入。这里的key是每个单词,values是一个可迭代的数据类型,类似(1,1,1,...)。

4.4 WordCountApp

组装MapReduce作业,并提交到服务器运行,代码如下:

1 |

|

需要注意的是:如果不设置Mapper操作的输出类型,则程序默认它和Reducer操作输出的类型相同。

4.5 提交到服务器运行

在实际开发中,可以在本机配置hadoop开发环境,直接在IDE中启动进行测试。这里主要介绍一下打包提交到服务器运行。由于本项目没有使用除Hadoop外的第三方依赖,直接打包即可:

1 |

使用以下命令提交作业:

1 | hadoop jar /usr/appjar/hadoop-word-count-1.0.jar \ |

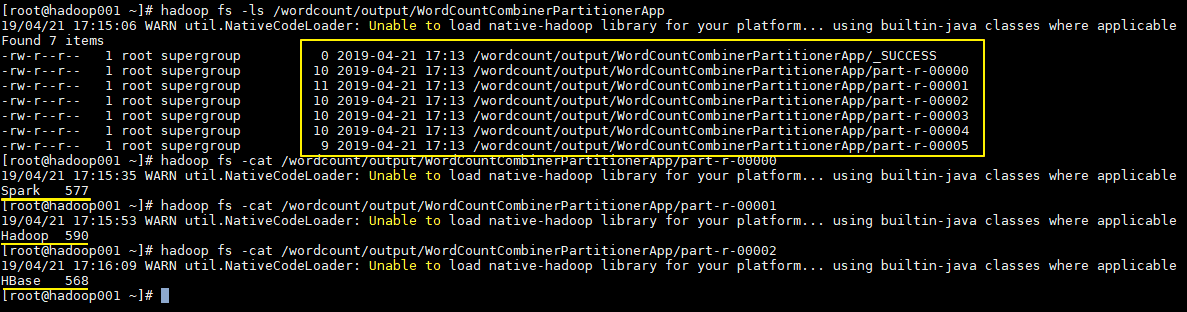

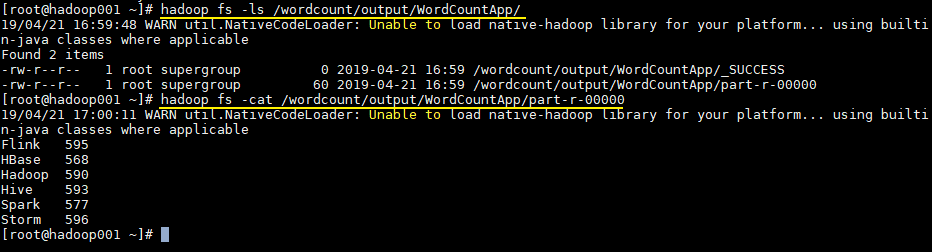

作业完成后查看HDFS上生成目录:

1 | # 查看目录 |

五、词频统计案例进阶之Combiner

5.1 代码实现

想要使用combiner功能只要在组装作业时,添加下面一行代码即可:

1 | // 设置Combiner |

5.2 执行结果

加入combiner后统计结果是不会有变化的,但是可以从打印的日志看出combiner的效果:

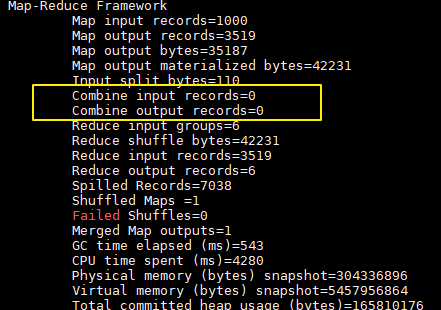

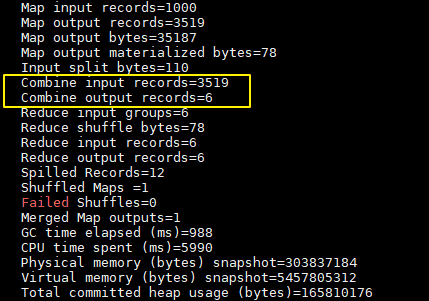

没有加入combiner的打印日志:

加入combiner后的打印日志如下:

这里我们只有一个输入文件并且小于128M,所以只有一个Map进行处理。可以看到经过combiner后,records由3519降低为6(样本中单词种类就只有6种),在这个用例中combiner就能极大地降低需要传输的数据量。

六、词频统计案例进阶之Partitioner

6.1 默认的Partitioner

这里假设有个需求:将不同单词的统计结果输出到不同文件。这种需求实际上比较常见,比如统计产品的销量时,需要将结果按照产品种类进行拆分。要实现这个功能,就需要用到自定义Partitioner。

这里先介绍下MapReduce默认的分类规则:在构建job时候,如果不指定,默认的使用的是HashPartitioner:对key值进行哈希散列并对numReduceTasks取余。其实现如下:

1 | public class HashPartitioner<K, V> extends Partitioner<K, V> { |

6.2 自定义Partitioner

这里我们继承Partitioner自定义分类规则,这里按照单词进行分类:

1 | public class CustomPartitioner extends Partitioner<Text, IntWritable> { |

在构建job时候指定使用我们自己的分类规则,并设置reduce的个数:

1 | // 设置自定义分区规则 |

6.3 执行结果

执行结果如下,分别生成6个文件,每个文件中为对应单词的统计结果: